AI Act

Ziel des AI Acts

Der AI Act soll gewährleisten, dass KI-Systeme und -Modelle, die auf dem EU-Markt in Verkehr gebracht und in der Union verwendet werden, im Sinne einer digitalen Verantwortungsgesellschaft und der europäischen Werte sicher eingesetzt werden. Er ist eine umfassende Verordnung über KI und soll die Sicherheit, Robustheit und Vertrauenswürdigkeit von KI-Systemen in Europa sicherstellen.

Dabei wird ein „risikobasierter“ Ansatz verfolgt: Je höher das Risiko, desto strenger die Vorschriften. Der europäische AI Act ist ein wegweisendes Regelwerk, das auch als Vorbild für andere Staaten dienen kann.

Österreich hat bereits mit der Umsetzung des AI Act begonnen.

Artikel 77 AI Act

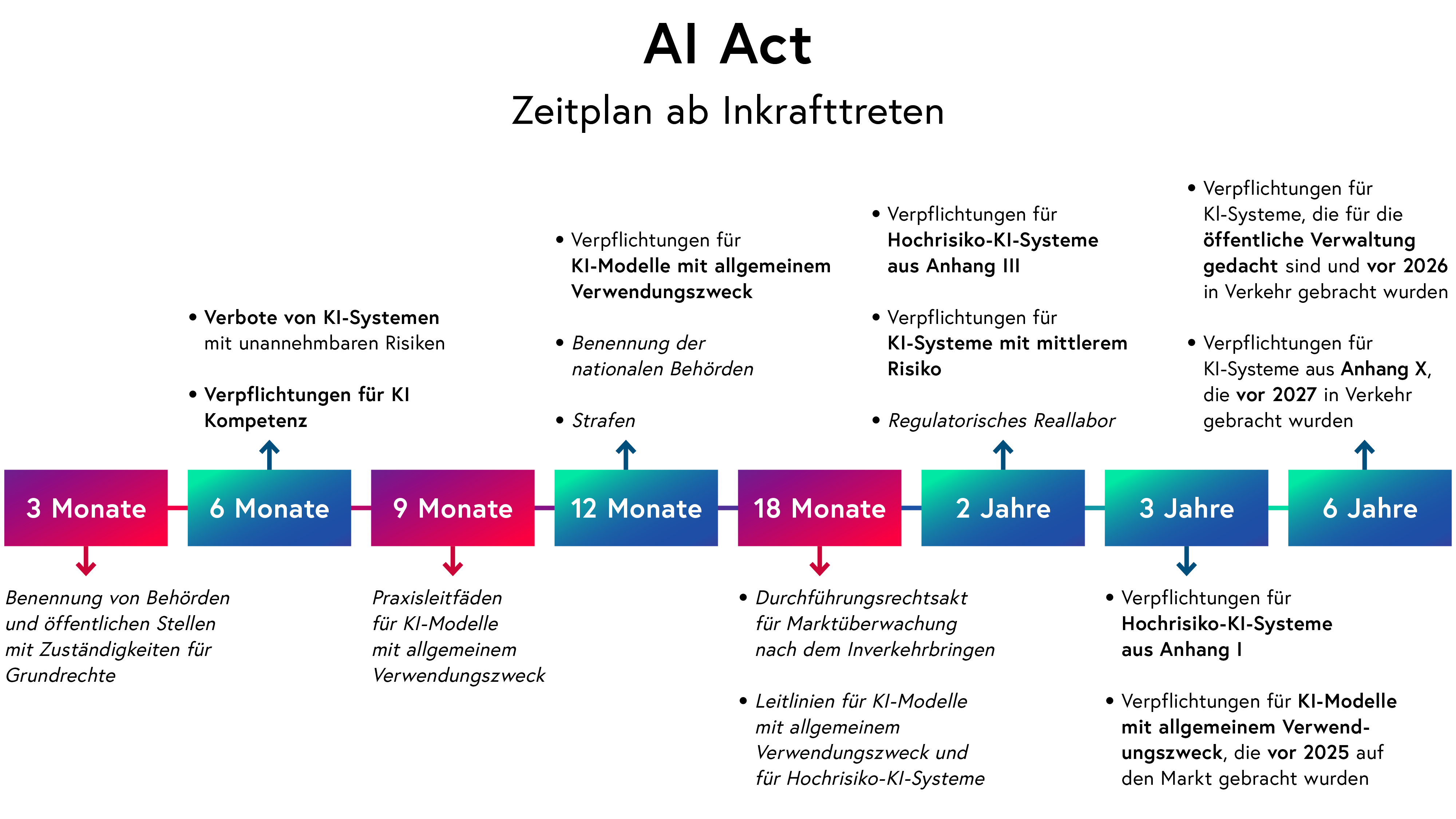

Mit der Veröffentlichung im Amtsblatt der Europäischen Union am 12. Juli 2024 trat der europäische AI Act am 1. August 2024 in Kraft. Ab diesem Zeitpunkt laufen sämtliche Fristen für die Umsetzung durch den Staat, durch Unternehmen und andere Organisationen.

Der AI Act bestärkt mit Artikel 77 AI Act bestehende Aufsichts- und Durchsetzungsbefugnisse von Behörden bzw. öffentlichen Stellen für Grundrechte. Diese waren bis 2. November 2024 zu benennen und sind mit weiteren Informationen auf einer eigenen Informationsseite zu finden.

Services

-

Wirtschaft KI-BildstreckenKI-Bildstrecken

Wirtschaft KI-BildstreckenKI-BildstreckenPassende Bilder zu Themen bezugnehmend zu KI gibt es zur Nutzung für die kostenlose redaktionelle Berichterstattung unter Angabe des Copyrights.

-

Wirtschaft KI-MarktplatzKI-Marktplatz

Der KI-Marktplatz des Austria Wirtschaftsservice unterstützt, passende Anbieter und Kooperationspartner für eigene KI-Projekte schnell zu finden.

-

Wirtschaft KI-Servicestelle der RTRKI-Servicestelle der RTR

Die in der RTR eingerichtete Servicestelle für künstliche Intelligenz dient als Ansprechpartner und Informationshub zu Themen rund um KI.

-

Offene Daten & Transparenzangebote Digitale Verwaltung LeitfädenDigitale Verwaltung Leitfäden

Ein verantwortungsvoller und ethisch korrekter Einsatz digitaler Werkzeuge steigert Effizienz und Effektivität der Verwaltung.